文章相关引用及参考:XR导航网

(XR导航网 2023年12月30日)近期美国专利及商标局公布了一批全新的AR/VR专利,以下是XR导航网的整理(详情请点击专利标题),一共78篇。更多专利披露请访问XR导航网专利板块https://patent.nweon.com/进行检索,你同时可以加入XR导航网AR/VR专利交流微信群(详见文末)。

1. 《Meta Patent | Dynamic speech directivity reproduction(Meta专利:动态语音指向性再现)》

在一个实施例中,专利描述的方法可以包括经由扬声器的人工现实设备的头戴式麦克风捕获在人工现实环境中与听者通信的扬声器的语音输入;检测扬声器在人工现实环境内的姿势,以及确定扬声器相对于听者在人工真实环境内的位置的位置;基于扬声器在人工现实环境内的姿势和相对位置来处理语音输入,以创建用于听者的方向性调谐语音信号,并将方向性调谐的语音信号传送到收听者的人工现实设备。

在一个实施例中,用于执行低密度奇偶校验(LDPC)编码的系统和方法可以包括,确定多个信息比特的计数的无线通信设备。无线通信设备可以根据计数来选择码字长度。无线通信设备的LDPC编码器可以生成用于多个信息比特的码字。无线通信设备可以将码字发送到另一无线通信设备的LDPC解码器。

在一个实施例中,专利描述了LED器件和相应的制造技术。LED器件包括第一掺杂半导体层、具有相反掺杂的第二掺杂半导体层和发光单元的2D阵列。每个发光单元对应于单个像素的台面,并且包括至少一个量子阱。2D阵列位于第一掺杂半导体层和第二掺杂半导体层之间。LED器件同时包括在第一掺杂半导体层和2D阵列之间的平坦化层。平坦化层包括完全覆盖2D阵列中的每个发光单元的侧壁的未掺杂量子势垒(QB)层。未掺杂的QB层量子地将发光单元彼此隔离。平坦化或未掺杂的QB层还可以在台面像素化工艺期间保护发光单元不受蚀刻引起的缺陷的影响。

在一个实施例中,专利描述的方法包括从与第一用户相关联的客户端系统接收来自第一用户的用户请求,其中所述用户请求包括来自所述第一用户的手势输入和来自所述第二用户的语音输入;基于由与所述第一用户相关联的个性化手势分类模型输入的手势来确定与所述用户请求相对应的意图;基于所确定的意图和所述语音输入来执行一个或多个任务;以及响应于所述用户请求向所述客户端系统发送用于呈现所述一个或更多个任务的执行结果的指令。

在一个实施例中,提供用于与当前XR应用程序交互的用户界面、提供所选项目的详细视图、在多个虚拟世界之间导航而不必在这些世界的家庭大厅中来回转换、在由第一XR应用控制的世界内执行第二XR应用以及提供与当前世界分离的3D内容。XR应用程序可以定义为与个人界面一起使用,以创建经由个人界面显示的3D世界部分和2D界面部分。

在一个实施例中,提供用于与当前XR应用程序交互的用户界面、提供所选项目的详细视图、在多个虚拟世界之间导航而不必在这些世界的家庭大厅中来回转换、在由第一XR应用控制的世界内执行第二XR应用以及提供与当前世界分离的3D内容。XR应用程序可以定义为与个人界面一起使用,以创建经由个人界面显示的3D世界部分和2D界面部分。

7. 《Meta Patent | Three-dimensional face animation from speech(Meta专利:根据语音进行三维人脸动画化)》

在一个实施例中,专利描述了一种根据语音训练三维模型人脸动画模型的方法。所述方法包括基于来自第一对象的音频波形来确定面部特征的第一相关值;基于面部特征和第一相关值来生成人脸下部的第一网格;当所述第一网格与所述第一对象的真实地面图像之间的差大于预先选择的阈值时,更新所述第一相关值;以及基于第一对象的第一网格和地面实况图像之间的差异;将通过语音动画化的人脸的三维模型提供给由客户端设备访问的沉浸式现实应用。

在一个实施例中,专利描述的系统针对用于可互换地提供对多个虚拟世界的访问的虚拟Web浏览器。对应的网站和虚拟世界对的浏览器选项卡可以与相关联的控件一起显示,对这样的控件的选择影响虚拟世界的3D内容的实例化。作为与虚拟世界中的对象的交互的结果,可以自动生成一个或多个选项卡,从而便于前往与交互所指向的对象相对应的世界。

9. 《Meta Patent | Lighting unit with zonal illumination of a display panel(Meta专利:具有显示面板区域照明的照明单元)》

在一个实施例中,用于显示面板的照明单元包括光分布模块、耦出器阵列和光束点阵列生成模块。光分布模块包括多个输出波导,用于在输出波导之间可配置地分布照明光。每个耦出器耦合到输出波导,并且配置为耦出照明光的一部分以向显示面板传播。光束点阵列生成模块配置为接收由耦出器耦出的照明光的部分,并且转换每个部分以利用包括光束点阵列的照明光场来照明显示面板的区域。每个光点配置用于照明显示面板的区域的单个像素或子像素。

在一个实施例中,专利描述的系统可以确定用户的瞳孔间距离和用户的适眼距。系统可以使得调节组件至少部分地基于瞳孔间距离沿着第一轴调节第一透镜和第二透镜之间的第一距离,并且使得调节组件沿着第二轴调节光学组件第二距离。

在一个实施例中,专利描述的光学组件可以包括投影仪组件、波导和至少两个支座。投影仪组件可以包括至少一个光投影仪和外壳。波导可以包括与至少一个光投射器相对应的至少一个输入光栅。支座可以在外壳和波导之间,并且可以配置用于将至少一个光投射器与至少一个输入光栅对准。

在一个实施例中,专利描述的系统可以确定用户的瞳孔间距离和用户的适眼距。系统可以使得调节组件至少部分地基于瞳孔间距离沿着第一轴调节第一透镜和第二透镜之间的第一距离,并且使得调节组件沿着第二轴调节光学组件第二距离。

在一个实施例中,专利描述的系统包括表面起伏光栅,表面起伏光栅配置为将输入光束向前衍射为两个线性偏振光束。所述系统还包括波片,波片与表面起伏光栅光学耦合并且配置为将两个线性偏振光束转换成具有正交圆偏振的两个圆偏振光束。具有正交圆偏振的两个圆偏振光束彼此干涉以产生偏振干涉图案。

14. 《Microsoft Patent | Determining charge on a facial-tracking sensor(微软专利:确定面部追踪传感器的电荷)》

在一个实施例总,专利描述了基于累积在感测电容器电极上的电荷来确定电容的方法。头戴式设备包括面部追踪传感器、控制器和连接到面部追踪传感器的电荷感测电路。所述面部追踪传感器包括感测电容器电极和控制器,所述感测电容电极配置为定位在面部表面附近,并基于所述感测量电容器电极与所述面部表面之间的距离形成电容,所述控制器配置为将参考电压施加到所述感传感器电容器电极。电荷感测电路配置为通过确定由参考电压引起的在感测电容器电极上累积的电荷量来确定感测电容电极的电容。

15. 《Microsoft Patent | Gesture recognition based on likelihood of interaction(微软专利:基于交互可能性的手势识别)》

在一个实施例中,专利描述了一种用于评估手势输入的方法,包括接收顺序数据帧的输入数据。第一神经网络训练为识别指示后续手势交互的特征,并且配置为评估数据帧序列的输入数据,同时输出用户在数据帧的预定窗口期间执行手势交互的可能性的指示。第二神经网络训练为识别指示用户当前是否正在执行一个或多个手势交互的特征,并且配置为基于指示的可能性在预定窗口期间调整手势交互识别的参数。第二神经网络基于调整后的参数评估预定窗口中执行的手势交互,并输出关于用户是否在预定窗口期间执行一个或多个手势交互的信号。

在一个实施例中,专利描述了一种用于可导航模拟环境的基于像素的自动测试的计算系统。处理器被配置为在运行时推断阶段执行应用程序测试程序。应用程序测试程序包括机器学习模型,模型训练为检测被测应用程序中的错误。模拟环境的屏幕图像由对象检测模块处理,以确定屏幕图像中是否存在关键对象。如果屏幕图像中存在关键对象,则应用程序测试程序执行对象调查模块以生成调查输入以调查关键对象。如果屏幕图像中不存在关键对象,则应用程序测试程序执行环境探索模块,以生成要提供给被测试应用程序的环境探索动作作为模拟用户输入。

17. 《Apple Patent | Method and system for acoustic passthrough(苹果专利:声学穿透的方法和系统)》

在一个实施例中,专利描述了一种由第一用户佩戴的第一头显执行的方法。所述方法包括第一头显对麦克风捕获的麦克风信号执行噪声消除,其中麦克风信号布置成捕获第一用户所处的周围环境内的声音。第一头显通过无线通信链路从处于周围环境中的第二用户所佩戴的第二头显接收由第二头显的至少一个传感器产生的,并通过基于接收到的声音特性的麦克风信号的选择声音的至少一种声音特性。

18. 《Apple Patent | Gaze-based exposure(苹果专利:基于注视点的曝光)》

在一个实施例中,专利描述了一种用于混合现实系统的处理管道和方法。所述方法基于注视对场景中的感兴趣区域使用选择性自动曝光,并且基于场景的环境照明信息补偿场景的其余部分的曝光。然后可以生成用于显示的图像,其为用户提供曝光补偿的高动态范围(HDR)体验。

在一个实施例中,专利描述的电子设备可以包括立体显示器,立体显示器具有在显示器的长度上延伸的多个双凸透镜。双凸透镜可以配置为实现显示器的立体观看,以使得观看者感知三维图像。显示器可以具有不同的观看区域,而观看区域在观看者相对于显示器水平移动时考虑水平视差。基于检测到的观看者的垂直位置,显示器可以全局调暗、模糊和/或与默认图像合成。显示器可以呈现补偿多个观看者的实时垂直位置的内容。

20. 《》

在一个实施例中,专利描述了媒体编辑方法和图形用户界面。媒体编辑用户界面包括用于捕获和编辑由多个媒体记录设备生成的媒体的多个用户界面选项和工具;修改媒体记录设备的状态以将相应内容添加到媒体流;媒体编辑用户界面包括来自相应媒体记录设备的定向的媒体内容的表示;媒体编辑用户界面可以呈现用于改变媒体流的内容以及发布和/或导出媒体流的属性的控件。

21. 《Apple Patent | Visual indication of audibility(苹果专利:可听性的视觉指示)》

在一个实施例中,专利描述了用于显示可听信号的可听性的视觉指示的方法。所述方法包括经由音频传感器接收可听信号并将可听信号转换为电子信号数据;获得指示设备所处的物理环境的音频响应特性的环境数据;在显示器显示指示符,该指示符指示与可听信号的源的距离。其中,距离基于与电子信号数据相关联的幅度和物理环境的音频响应特性。

22. 《Apple Patent | Showing context in a communication session(苹果专利:在交流会话中显示情景)》

在一个实施例中,专利描述的方法提供除用户的物理环境之外的3D环境内的用户的至少一部分的表示。基于检测到条件,显示用户的物理环境的另一对象的表示以提供情景。作为示例,可以基于检测到用户坐着来示出就坐表面的表示,可以基于探测到用户伸手拿起咖啡杯来示出桌子和咖啡杯的表示,基于探测到声音或用户将注意力转向移动物体或声音来示出第二用户的表示,并且当探测到小狗的吠叫时可以示出小狗的描绘。

在一个实施例中,专利描述的技术用于在计算机生成现实(CGR)环境内提供虚拟对象的有形可视化。为CGR环境内的虚拟对象提供指示有形性的视觉反馈,虚拟对象不对应于真实环境中的真实有形对象。

24. 《Apple Patent | Context-based object viewing within 3d environments(苹果专利:3D环境中基于情景的对象查看)》

在一个实施例中,呈现3D环境的视图。然后,确定与在3D环境内观看一个或多个媒体对象相关联的情景。基于情景,确定用于在3D环境内观看一个或多个媒体对象中的媒体对象的观看状态。根据观看状态是第一观看状态的确定,使用其相关联的数据在3D环境内呈现媒体对象以提供深度的外观。

25. 《Apple Patent | Warping an input image based on depth and offset information(苹果专利:基于深度和偏移信息扭曲输入图像)》

在一个实施例中,专利描述的方法包括经由图像传感器获得包括对象的输入图像;获得表征对象的深度信息,其中该深度信息表征图像传感器和对象的一部分之间的第一距离;基于深度信息和表征用户眼睛与显示设备之间的估计距离的第一偏移值的函数来确定输入图像的距离扭曲图;基于距离扭曲图设置电子设备的操作参数;以及通过设置为操作参数的电子设备从输入图像生成扭曲图像。

在一个实施例中,专利描述的电子设备在显示包括一个或多个虚拟对象的三维环境时,检测用户朝向三维环境中的第一虚拟对象的注视。注视满足第一标准,并且第一虚拟对象响应于至少一个手势输入。响应于检测到满足第一标准的注视,根据手处于用于提供手势输入的预定义准备状态的确定,电子设备显示在三维环境中可用于第一虚拟对象的一个或多个交互选项的指示;并且根据手没有处于用于提供手势输入的预定义准备状态的确定,电子设备放弃显示可用于第一虚拟对象的一个或多个交互选项的指示。

在一个实施例中,专利描述的系统提供计算机生成的现实(CGR)环境。其中用户参与活动,基于关于用户身体的数据来识别用户的认知状态(例如,工作、学习、休息等),以及用促进用户对活动的认知状态的周围环境来更新环境。

28. 《Apple Patent | Display systems with optical sensing(苹果专利:光学传感显示系统)》

在一个实施例中,专利描述的头戴式设备可以具有折反射透镜,每个折反射透镜包括部分反射镜、四分之一波片和偏振器。头戴式设备中的光学系统可以具有红外发光装置和红外光感测装置。光学系统可以在视窗中照射用户的眼睛,并且可以从被照射的视窗收集测量值以用于眼睛追踪和其他功能。光学系统可以通过折反射透镜进行操作。为了增强光学系统性能,偏振器可以是由表现出增强的红外透射的导线形成的线栅偏振器,和/或四分之一波片可以由胆甾醇型液晶层形成。胆甾型液晶层在可见波长下用作四分之波片,而在红外波长下不用作四分之一波片。

29. 《Apple Patent | Controlling a user selection queue(苹果专利:控制用户选择队列)》

在一个实施例中,专利描述的方法包括在CGR环境中显示计算机生成的现实对象;CGR对象表示一个物理物品。;合成与CGR对象相关联的可供;检测指向可供性的输入;响应于检测到输入,将标识物理物品的标识符添加到用户选择队列。

30. 《Apple Patent | Gaze behavior detection(苹果专利:注视行为检测)》

在一个实施例中,示例过程可以包括获取第一时间段内与注视相关联的眼睛数据;获取在第一时间段期间与注视相关的头部数据(例如,头部位置和速度);确定第一时间段期间的第一注视行为状态,以识别注视转移事件、注视保持事件和丢失事件。

31. 《Apple Patent | Controlling a 设备 setting using head pose(苹果专利:使用头部姿势控制设备设置)》

在一个实施例中,专利描述的头戴式设备可以使用头部姿势改变来进行用户输入。特别地,头戴式设备中的显示器可以显示具有指示器的滑块。滑块可以是诸如音量或亮度之类的设备设置的标量的视觉表示。基于头部姿势的变化,可以更新设备设置的标量和指示器在滑块上的位置。头部移动的方向可以对应于指示器在滑块中的移动方向。

32. 《Apple Patent | Electronic 设备s with deformation sensors(苹果专利:带变形传感器的电子设备)》

在一个实施例中,专利描述的头戴式设备可以具有头戴式支撑结构,头戴式支持结构配置为佩戴在用户的头部上。头戴式设备可以具有立体光学部件,例如左和右摄像头或左和右显示系统。光学组件可以具有各自的左指向矢量和右指向矢量。支撑结构的变形可能导致摄像头指向矢量和/或显示系统指向矢量变得不对准。诸如应变仪电路的传感器电路可以测量指向矢量未对准。控制电路可以控制摄像头和/或显示系统以补偿指向矢量未对准的测量变化。

33. 《Apple Patent | Electronic 设备 with lens position sensing(苹果专利:具有透镜位置感应功能的电子设备)》

在一个实施例中,头戴式设备可以具有具有为用户显示内容的像素阵列的显示器。设备中的头戴式支撑结构支撑用户头部上的像素阵列。左定位器可用于定位包括左透镜和第一像素阵列的左透镜组件。右定位器可用于定位包括右透镜和第二像素阵列的右透镜组件。控制电路可以使用瞳孔间距离信息来调整左透镜组件和右透镜组件的位置。可以使用诸如力感测电路的感测电路来确保透镜组件不会在鼻子上施加过大的力。

在一个实施例中,系统可以执行一种方法来识别一个或多个镜片何时是用户的错误处方。系统通知用户切换处方镜片或启动镜片的配准过程。系统可以识别镜片的处方,并将所识别的处方与用户的一个或多个注册处方进行比较。当识别出的镜片处方与用户的预期注册处方不匹配时,系统可以通知用户切换处方镜片。

35. 《Apple Patent | Augmented reality maps(苹果专利:AR地图)》

在一个实施例中,手持通信设备可以捕获并显示实时视频流。手持通信设备检测手持通信设备的地理位置和摄像头方向。识别从手持通信设备的地理位置到兴趣点的路线。用指示行进到感兴趣点的方向的指示符在视觉上增强所捕获的视频流。指示符叠加在捕获的实时视频流上。

36. 《Google Patent | Device tracking with integrated angle-of-arrival data(谷歌专利:集成到达角数据的设备追踪)》

在一个实施例中,头戴式显示器基于由例如超宽带(UWB)定位模块生成的到达角(AOA)数据和由惯性测量单元IMU生成的惯性数据的组合来识别设备姿态。头显使用数据集成技术将AOA数据与惯性数据融合。

37. 《Google Patent | List navigation with eye tracking(谷歌专利:基于眼动追踪的列表导航)》

在一个实施例中,专利所描述的技术使得能够在显示器上显示围绕中心位置布置的多个位置,所述多个位置包括至少一个空位置;并且填充位置显示列表元素的第一子集,所述填充位置包括与所述至少一个空白位置相邻的相邻位置。可以追踪注视点相对于填充位置并且围绕中心位置朝向至少一个空位置的移动。至少一个空位置可以用列表元素的列表元素填充,并且相邻位置可以清空,从而显示列表元素的第二子集。

38. 《Google Patent | Volumetric performance capture with neural rendering(谷歌专利:使用神经渲染的体积性能捕获)》

在一个实施例中,专利描述的技术可以包括使用光台和使用红外摄像头的与被摄体相对应的深度数据来初始地获得从多个视点,并且在各种照明条件下描绘被摄体的图像。神经网络可以基于深度数据从图像中提取对象的特征,并将特征映射到纹理空间中。神经渲染器可用于从目标视图生成描绘对象的输出图像,使得输出图像中对象的照明与目标视图对准。神经渲染可以将对象的特征从纹理空间重新采样到图像空间,以生成输出图像。

在一个实施例中,专利描述的图像生成设备包括配置为识别玩家的身体的玩家识别部分、配置为获取包括视点位置和视点方向的视点信息的视点获取部分、配置为基于识别的结果生成反映玩家的身体骨架的玩家的网格结构的网格生成部分、以及配置为通过渲染玩家的网格结构和当从视点信息中的视点位置在视点方向上观看时的虚拟对象来生成图像,并且将渲染的虚拟对象叠加在渲染的玩家的网格结构上的图像生成部分。

在一个实施例中,专利描述的信息处理设备包括:从被摄体的拾取图像中提取被摄体轮廓的轮廓提取单元;通过从构成轮廓的点提取采样点来提取特征量的特征量提取单元:估计高度匹配的姿势来作为被摄体的姿势的估计单元;以及在估计单元进行估计时使用匹配成本来确定估计单元的估计精度的确定单元。

41. 《Sony Patent | Haptic system and method(索尼专利:触觉反馈系统和方法)》

在一个实施例中,专利描述的触觉反馈方法包括:提供包括一个或多个骨传导触觉反馈单元的可穿戴触觉反馈设备,并用使用骨传导头相关传递函数“bHRTF”处理的至少第一信号驱动所述一个或更多个骨传导触感反馈单元。

42. 《Sony Patent | Display apparatus(索尼专利:显示装置)》

在一个实施例中,专利描述的显示设备包括显示单元组。显示单元组包括沿圆周方向布置的至少两组或更多组显示单元。每组显示单元包括屏幕和反射全息透镜,对象图像从投影设备投影到屏幕上,反射全息透镜衍射对象图像并将对象图像传送到观察者的瞳孔。

在一个实施例中,专利描述的信息处理设备包括:获取由预定成像部分捕获的图像的获取部分;估计实际空间中的第一位置和第二定位的估计部分;以及基于估计结果测量第一位置和第二位置之间的距离的测量部分。

在一个实施例中,专利描述了一种用于在头戴式显示器中使用的虚拟现实内容的分类方法。所述方法包括访问识别与可能引起不适的对应基线VR内容的生成相关联的多个学习模式的模型;执行第一应用程序以生成第一VR内容;提取与第一VR内容的模拟用户交互相关联的数据,所提取的数据在第一应用的执行期间生成;将提取的数据与模型进行比较,以识别提取的数据中与来自模型的学习模式中的至少一个匹配的一个或多个模式,使得一个或更多个模式可能引起不适。

在一个实施例中,专利描述的方法包括捕获图像并将图像与摄像头姿势相关联;为每个摄像头确定用于在第一显示器上显示的第一虚拟视图的图像的第一贡献,和用于在第二显示器上显示第二虚拟视图的该图像的第二贡献;对于每个摄像头,基于摄像头姿势和摄像头相对于第一虚拟摄像头的位置来确定第一虚拟视图的第一置信度图;以及基于摄像头姿势以及摄像头相对于第二虚拟摄像头的位置来确定第二虚拟视图的第二置信度图;通过使用针对每个摄像头的第一置信度图组合第一贡献来生成第一虚拟视图;以及通过使用针对每一个摄像头的第二置信度图结合第二贡献来生成第二虚拟视图。

在一个实施例中,用于由电子设备在虚拟环境中处理安全虚拟事件的方法包括从第一用户化身接收至少一个输入,以在虚拟环境内创建至少一个虚拟事件;基于接收到的来自第一用户化身的输入和虚拟事件的性质来识别用于参与至少一个创建的虚拟事件的至少一个第二用户化身;并且确定与和至少一个第一用户化身相关联的至少一动作相对应的至少一种安全策略,以及至少一个参数来创建虚拟事件。

47. 《Samsung Patent | Display apparatus for providing expanded viewing window(三星专利:用于提供扩展观看窗口的显示设备)》

在一个实施例中,专利描述了一种能够提供扩展的观看窗口的显示设备。所述设备包括导光板,导光板包括耦入器和耦出器;以及提供图像的图像提供设备。所述耦入器可以包括多个子耦入器,所述子耦入器配置为在导光板中以不同角度传播从图像提供设备提供的图像。

48. 《Samsung Patent | Display module and head-mounted display 设备 therewith(三星专利:显示模块及其头戴式显示设备)》

在一个实施例中,专利描述的显示模块包括多个发光元件和密封所述多个发光元素的密封元件。密封元件包括基底部分和覆盖层,基底部分包括透明材料。所述覆盖层与所述基部的表面接触,并且包括多个第一图案和多个第二图案,所述第一图案中的每一个以凹版方式雕刻到第一深度,所述第二图案中的每个以凹版方式蚀刻到不同于所述第一深度的第二深度。

在一个实施例中,专利描述的系统基于用户生物特征(例如血氧饱和度、心率、体温、血压等)来防止用户过度沉迷于元宇宙。如果生物特征表明用户的健康因元宇宙呈现而受损,元宇宙呈现可以改变以减少用户的过度放纵。

50. 《Qualcomm Patent | Object detection and tracking in extended reality 设备s(高通专利:扩展现实设备中的对象检测和追踪)》

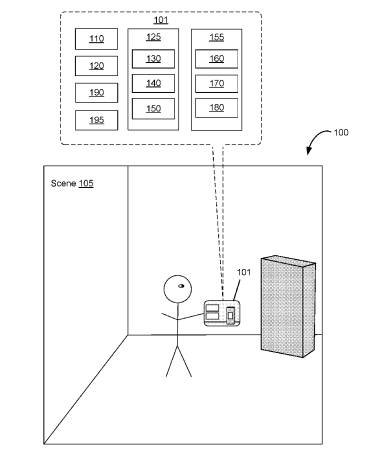

在一个实施例中,专利描述了用于在扩展现实环境中检测和追踪对象的方法。例如,计算设备可以检测混合环境的放置区域中的对象。响应于检测,计算设备可以确定对象的至少一个参数,可以基于至少一个参量来对准对象,并且可以基于对准来追踪对象的移动。在另外的实施例中,计算设备可以捕获对象的至少一个图像,可以基于该至少一个图片生成多个数据点,可以基于多个数据点将多维模型生成,并且可以基于多维模型生成多个动作点。计算设备可以基于多个动作点来追踪对象的移动。

51. 《Qualcomm Patent | Physical layer association of extended reality data(高通专利:扩展现实数据的物理层关联)》

在一个实施例中,专利描述了用于无线通信的方法。所述方法可以包括用户设备(UE)接收第一控制信息,所述第一控制信息包括与共同表示用于解码的数据单元的一组不同PDU相关联的第一分组数据单元(PDU)集合标识符(ID)。在接收到第一控制信息时,UE可以基于第一控制信息来识别PDU是与第一PDU集合ID相对应的不同PDU集合的一部分,并且基于作为不同PDU集合一部分的PDU来确定是否将所述PDU包括在与网络实体的通信中。

52. 《Qualcomm Patent | Methods and apparatus for foveated compression(高通专利:注视点压缩的方法和装置)》

在一个实施例中,专利描述的系统可以在服务器处呈现包括显示内容的至少一个帧;缩减包括显示内容的至少一个帧;可以将包括显示内容的缩小的至少一个帧传送到客户端设备;对包括显示内容的缩小的至少一个帧进行编码;对包括显示内容的编码的至少一个帧进行解码;可以upscale包括显示内容的至少一个帧。

53. 《Snap Patent | Whole body segmentation(Snap专利:全身分割)》

在一个实施例中,系统执行的操作包括:接收包括用户全身描绘的单眼图像;基于所述单目图像生成所述用户的整个身体的分割;访问包括在所述单目图像之前接收的多个单目图像的视频馈送;使用视频馈送对基于单目图像生成的全身的分割进行平滑,以提供平滑的分割;以及基于平滑分割将一个或多个视觉效果应用于单目图像。

54. 《Snap Patent | Augmented reality image reproduction assistant(Snap专利|:增强现实图像再现助手)》

在一个实施例中,计算应用程序图像复制助手配置为帮助用户使用物理画布上的传统介质来将数字图像复制到物理画布。图像复制助手利用增强现实技术来呈现投影到物理画布上的数字图像的特征。图像复制助手在计算设备的相机的数字图像传感器的输出中检测先前生成的标记,并使用检测到的标记来计算物理画布的表面的平面和边界。图像复制助手使用计算的平面和边界来确定数字图像在计算设备的显示器上的位置。

55. 《Snap Patent | Double camera streams(Snap专利:双摄像头流)》

在一个实施例中,在包括显示器和摄像头的设备提供图像增强效果。接收由摄像头捕获的第一图像帧流,并向其应用增强现实效果以生成增强的图像帧流。图像帧的增强流实时地显示在显示器。与第一图像帧流相对应的第二图像帧流同时保存到初始视频文件。稍后可以从初始视频文件中检索第二图像帧流,并且独立于第一图像帧流而对其应用增强现实效果。

56. 《Snap Patent | Virtual selfie stick(Snap专利:虚拟自拍杆)》

在一个实施例中,专利描述了一种用于生成虚拟自拍杆图像的方法。所述方法包括在设备处利用该设备的光学传感器生成原始自画像图像;光学传感器指向用户的面部;设备保持在距用户的面部一臂长的位置;通过指令引导所述用户在多个姿势下并以手臂长度移动设备;在所述设备处访问由所述光学传感器在所述多个姿势处生成的图像数据;并且基于所述原始自拍图像和所述图像数据生成虚拟自拍杆的自拍图像。

57. 《Snap Patent | Applying pregenerated virtual experiences in new location(Snap专利:在新位置应用预生成的虚拟体验)》

在一个实施例中,系统执行的操作包括通过消息收发应用程序选择表示先前在第一位置捕获的真实世界环境的虚拟体验;访问在第二位置处表示新的真实世界环境的图像,所述图像描绘多个真实世界对象;接收从图像中描绘的多个真实世界对象中选择第一真实世界对象的输入;以及基于虚拟体验修改在第二位置访问的图像,以描绘具有第一真实世界对象的先前捕获的真实世界环境。

58. 《Snap Patent | Inferring intent from pose and speech input(Snap专利:从姿势和语音输入推断意图)》

在一个实施例中,系统执行的操作包括接收描绘人的图像、识别人的一组骨骼关节以及基于该组骨骼关节的定位来识别图像中描绘的人的姿势;接收包括执行AR操作的请求和模糊意图的语音输入;基于图像中描绘的人的姿势并响应于接收到语音输入来识别语音输入的模糊意图,基于基于图像中描绘的人的姿势识别语音输入的模糊意图来执行AR操作。

在一个实施例中,专利描述的方法包括使用移动设备的摄像头生成图像;访问与图像中的对象相对应的虚拟对象;基于用配对数据集预训练的机器学习模型来识别虚拟对象的照明参数;配对数据集包括合成源数据和合成目标数据,所述合成源数据包括环境地图和所述环境地图中描绘的项目的3D扫描,所述合成目标数据包括在同一环境地图中渲染的合成球体图像;将所述照明参数应用于所述虚拟对象,并且在所述移动设备的显示器中显示阴影虚拟对象作为图像的层。

60. 《Snap Patent | Robotic learning of assembly tasks using augmented reality(Snap专利:使用增强现实的装配任务机器人学习)》

在一个实施例中,专利描述的方法包括在AR设备的显示器中显示第一虚拟对象;使用AR设备追踪AR设备的用户对第一虚拟对象的操纵;基于所述追踪来识别所述第一虚拟对象的初始状态和最终状态,所述初始状态对应于所述第一虚拟对象的初始姿态,所述最终状态对应于第一虚拟对象最终姿态;并且通过演示使用所述对第一虚拟对象操纵的追踪来编程机器人系统,第一虚拟对象的第一初始状态和第一虚拟对象最终状态。

61. 《Snap Patent | Colocated shared augmented reality(Snap专利:并置共享增强现实)》

在一个实施例中,专利描述了用于创建共享AR会话的方法和系统。所述方法执行的操作包括:由客户端设备接收从多个共享AR体验中选择共享AR体验的输入;响应于接收到所述输入,确定与所选择的共享AR体验相关联的一个或多个资源;由客户端设备确定两个或多个用户位于客户端设备的阈值接近度内;以及响应于确定所述两个或多个用户位于所述客户端设备的阈值邻近度内而激活所选择的共享AR体验。

62. 《Snap Patent | Low-power hand-tracking system for wearable 设备(Snap专利:用于可穿戴设备的低功耗手部追踪系统)》

在一个实施例中,专利描述了一种用于低功率手部追踪系统的方法。所述方法包括轮询可穿戴设备的接近传感器以检测接近事件;所述可穿戴设备包括低功率处理器和高功率处理器,响应于检测到接近事件,基于来自所述接近传感器的接近数据在所述低功率处理器上操作低功率手部追踪应用;以及响应于以下中的至少一个来结束低功率手部追踪应用程序的操作:基于接近数据检测并识别手势、基于接近数据在不识别手势的情况下检测、或者基于接近数据从接近传感器检测到在超时时段内缺乏活动。

在一个实施例中,专利描述的波导包括波导主体,波导主体包括具有不同于周围介质的折射率并限定输出表面的光学透射材料。波导主体配置为通过在基本上与输出表面相切的一个或多个方向上的全内反射来传播光。波导包括一个或多个衍射光学元件(DOE)和DOE驱动器,每个衍射光学元件配置为响应于各自的激励而改变其衍射效率。

在一个实施例中,专利描述的颜色校准系统配置为允许用户在计算设备透视显示器显示虚拟颜色参考卡的同时调整色调/温度参数。虚拟颜色参考卡对应于放置在AR眼镜前面的物理颜色参考卡。基于用户通过颜色校准UI进行的调整,颜色校准系统对透视显示器的颜色属性进行更改。用户可以通过与颜色校准UI中的用户可选元素交互来继续调整透视显示器的属性,直到叠加在AR眼镜佩戴者的视场上的虚拟颜色参考卡的颜色与AR眼镜佩戴器看到的物理颜色参考卡颜色相匹配。

65. 《Snap Patent | Augmented reality riding course generation(Snap专利:增强现实骑程生成)》

在一个实施例中,AR增强的游戏性包括包括多个虚拟对象的球场地图,并定义参与者个人移动系统(如滑板车)的轨道。虚拟对象显示在参与者的增强现实设备的视场中。检测参与者或其个人移动系统与虚拟对象在现实世界中的位置的接近度,并且响应于接近度的检测,修改参与者的个人移动系统的性能特性。

66. 《Snap Patent | Wearable 设备 location systems(Snap专利:可穿戴设备定位系统)》

在一个实施例中,专利描述了用于可穿戴电子设备中的位置管理过程系统。当高速电路和定位电路从低功率状态引导时,低功率电路管理高速电路和位置电路,以在定位定位操作启动时自动地将位置辅助数据从高速电路提供给低功率电路。高速电路在完成定位之前以及在捕获与定位的发起相关联的内容之后返回到低功率状态。高速电路在完成位置定位之后更新与内容相关联的位置数据。

67. 《Lumus Patent | Head-mounted display eyeball tracker integrated system(Lumus专利:头显眼动追踪器集成系统)》

在一个实施例中,专利描述了具有眼动追踪系统的头戴式显示器。所属头显包括具有两个主表面和边缘的光透射基板、用于通过全内反射将光耦合到所述基板中的光学装置、由基板承载的与基板的主表面不平行的部分反射表面、近红外光源和在光致光谱内投影的显示源。

68. 《Lumus Patent | Optical system including selective illumination(Lumus专利:包括选择性照明的光学系统)》

在一个实施例中,至少一个处理器配置为至少部分地基于眼睛的瞳孔的相对位置从多个光源中选择光源。所选择的光源配置为用光束照射眼球运动框的与瞳孔的位置相对应的部分。所述至少一个处理器同时配置为激活所选择的光源以照射眼球运动框的所述部分。

69. 《Lumus Patent | Optical-based validation of orientations of surfaces(Lumus专利:基于光学的表面取向验证)》

在一个实施例中,专利描述的方法包括:提供样品,所述样品包括外部平坦的第一表面和外部平坦的第二表面,所述第二表面相对于所述第一表面名义上倾斜标称角度;产生指向第一表面的第一入射光束(LB)和平行于第一入射LB的第二入射LB;通过第一入射LB从第一表面反射来获得第一返回LB;通过以标称角度折叠第二入射LB,将折叠的LB反射离开第二表面,并以标称角度弯曲反射的LB来获得第二返回LB; 测量返回的LB之间的第一角度偏差;以及至少基于测量的第一角度偏差来推导第一-第二表面之间的实际倾角。

70. 《Vuzix Patent | Image light guide with zoned diffractive optic(Vuzix专利:带分区衍射光学器件的图像光导)》

在一个实施例中,用于传送虚像的图像光导包括波导、可操作用于将携带图像的光束引导到波导中的耦入衍射光学器件、以及可操作用于从波导将携带图像光束引导向视窗的耦出衍射光学件。所述耦出衍射光学器件具有两个或多个区域,每个区域包括一组衍射特征,其中第一区域包括第一组衍射特征并且第二区域包括第二组衍射特征并位于第一区域附近。耦出衍射光学器件包括由第一区和第二区形成的第一界面区域,并且第一界面区域包括第一组子区域和第二组子区域。第一组子区域包括第一组衍射特征,第二组子区域包含第二组衍射特征。

71. 《HTC Patent | Head-mounted display 设备 and display method therefor(HTC专利:头戴式显示设备及其显示方法)》

在一个实施例中,专利描述的头戴式显示设备包括显示器、透镜组和致动器。显示器用于生成图像光束。透镜组设置在显示器和目标区域之间,并且适于聚焦图像光束以在目标区域中形成显示图像。致动器耦合到显示器或透镜组以在平面上周期性地移动显示器或透镜群。

在一个实施例中,专利描述光学系统包括光学透射基板,基板包括一个次表面,所述次表面包括一个含有多个晶胞的光栅。每个晶胞包括具有第一宽度的第一纳米束;以及具有大于第一宽度的第二宽度的第二纳米束。晶胞的间距为10 nm到1.mu.m。当第一和第二纳米束的高度为10 nm到450 nm时,基板的折射率大于3.3;当高度是10 nm到1.mu.m时,折射率小于或等于3.3。

在一个实施例中,专利描述了一种用于增强现实的目镜波导。所述目镜波导可以包括透明基板,所述透明基板具有耦入区域,第一和第二正交光瞳扩展器(OPE)区域,以及出瞳扩展器(EPE)区域。耦入区域可以位于第一和第二OPE区域之间,并且可以将输入光束划分和重定向为在基板内部传播的第一和第二引导光束,其中第一引导光束指向第一OPE区域,第二引导光束指向第二OPE区域。第一和第二OPE区域可以分别将第一引导光束和第二引导光束分成多个复制的,间隔开的光束。EPE区域可以重新引导来自第一和第二OPE区域的复制光束,使得它们离开基板。

在一个实施例中,专利描述了用于在诸如增强现实显示系统的显示系统中选择深度平面的方法。显示器可以经由图像光向用户的眼睛呈现虚拟图像内容。显示器可以将图像光输出到用户的眼睛,图像光具有与在用户不同距离处的不同深度平面相对应的不同量的波前发散。摄像头可以捕捉眼睛的图像。可以基于所获得的眼睛的图像来生成用户是否被识别的指示。显示器可以将图像光输出到用户的眼睛。其中,图像光至少部分地基于所生成的指示而具有不同量的波前发散。

在一个实施例中,专利描述光学系统包括光学透射基板,基板包括一个次表面,所述次表面包括一个含有多个晶胞的光栅。每个晶胞包括具有第一宽度的第一纳米束;以及具有大于第一宽度的第二宽度的第二纳米束。晶胞的间距为10 nm到1.mu.m。当第一和第二纳米束的高度为10 nm到450 nm时,基板的折射率大于3.3;当高度是10 nm到1.mu.m时,折射率小于或等于3.3。

76. 《Magic Leap Patent | Virtual and augmented reality systems and methods(Magic Leap专利:虚拟现实和增强现实系统与方法)》

在一个实施例中,专利描述的虚拟现实或增强现实显示系统根据图像数据来控制对显示系统的电力输入。图像数据本身由多个图像数据帧组成,每个图像数据帧具有渲染内容的组成颜色分量和用于在渲染内容上显示的深度平面。中继来自光源的照明的光源或空间光调制器可以从显示控制器接收信号,以基于嵌入在图像数据帧中的控制信息来调整光源或空间光源调制器的功率设置和/或控制显示的图像内容的深度。

77. 《Niantic Patent | Localization using audio and visual data(Niantic专利:使用音频和视频数据的本地化)》

在一个实施例中,获得客户端设备的环境的参考图像和记录的声音。所记录的声音可以在客户端设备生成定位声音之后的一段时间内由客户端设备的麦克风捕获。可以使用参考图像和记录的声音来确定客户端设备在环境中的位置。

78. 《Niantic Patent | Compact head-mounted augmented reality system(Niantic专利:紧凑型头戴式增强现实系统)》

在一个实施例中,专利描述的头戴式设备可以包括前部、后部和一个或多个带。前部可以包括光学显示器。光学显示器配置为将图像光输出到用户的眼睛。后部可以与前部一起布置以平衡头显的重量。一个或多个带连接前部和后部,使得这两个部分位于用户头部的任一侧。

相关文章